Quests

#AI

10 posts

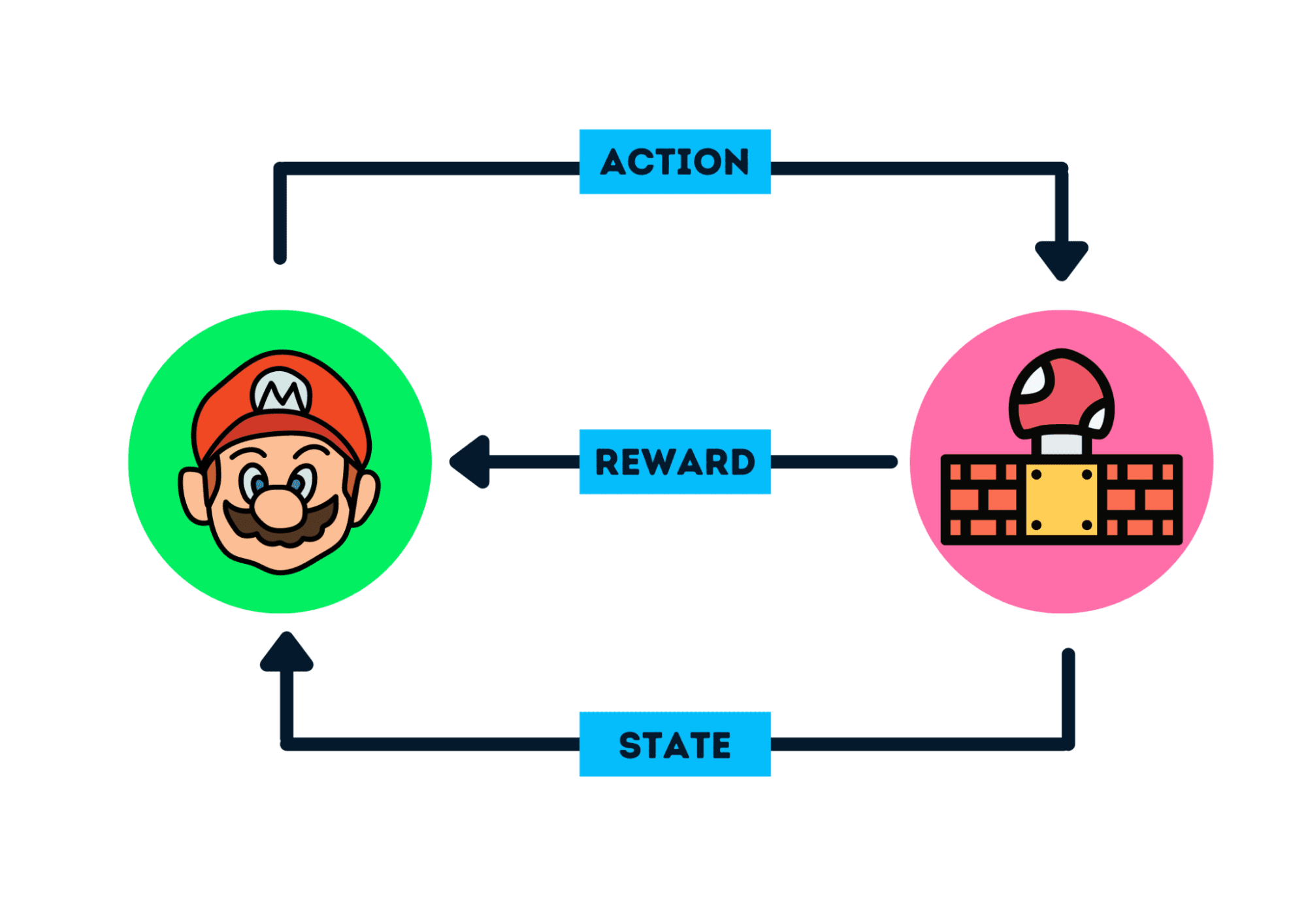

强化学习基础与 Q-Learning

从零开始学习强化学习的基础概念,深入理解 Q-Learning 算法及其在离散动作空间中的应用。

Vector Add in Triton

从最简单的向量加法开始,学习 Triton 内核的编写和性能调优技巧。

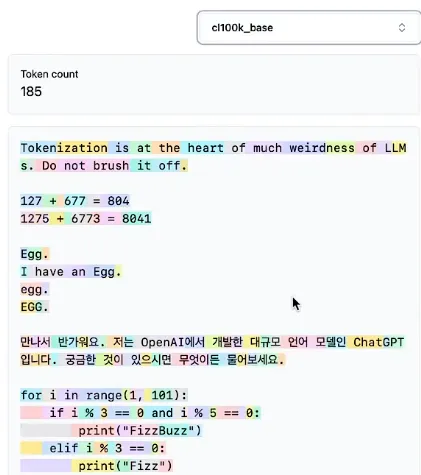

LLM 演进史 (六):揭开 Tokenizer 的神秘面纱

深入理解 Tokenizer 的工作原理,学习 BPE 算法、GPT 系列的分词策略以及 SentencePiece 的实现细节。

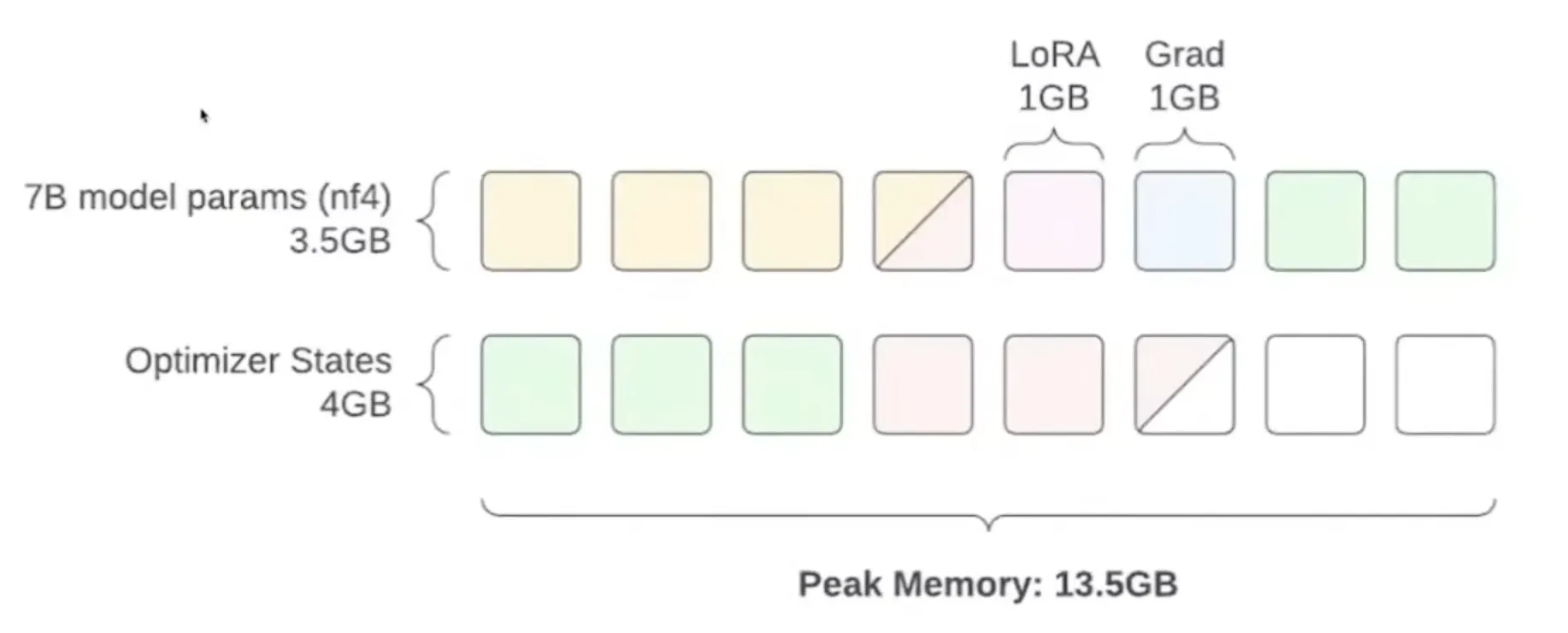

微调之道

学习如何在有限的显存条件下微调大语言模型,掌握半精度、量化、LoRA 和 QLoRA 等关键技术。

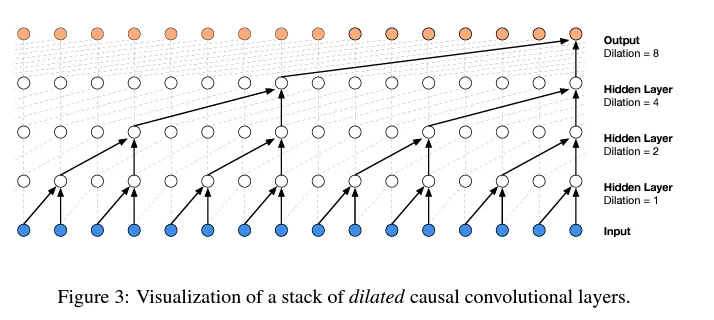

LLM 演进史 (四):WaveNet——序列模型的卷积革新

学习 WaveNet 的渐进式融合思想,实现树状分层结构来构建更深的语言模型。

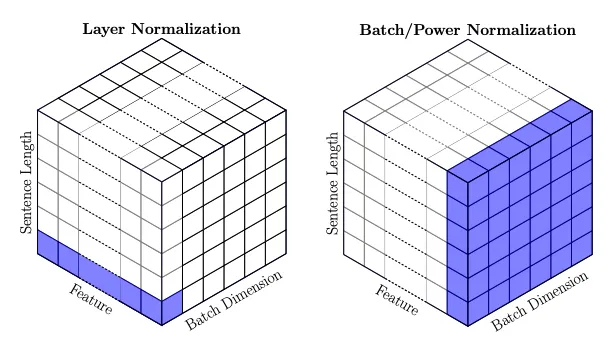

LLM 演进史 (三):批归一化——激活与梯度的统计调和

深入理解神经网络训练中的激活和梯度问题,学习批归一化如何解决深层网络的训练难题。

GPT 的现状

整理 Andrej Karpathy 在 Microsoft Build 2023 的演讲,深入理解 GPT 的训练过程、发展现状、当前 LLM 生态以及未来展望。

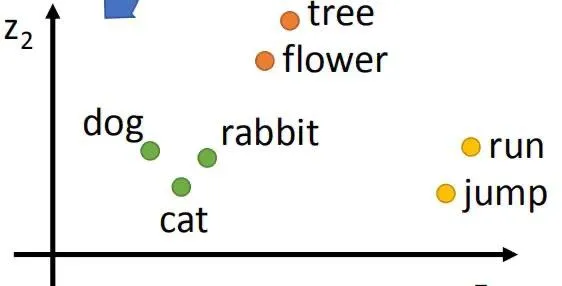

LLM 演进史 (二):词嵌入——多层感知器与语言的深层连接

探索 Bengio 的经典论文,了解如何通过神经网络学习词的分布式表示,以及如何构建一个神经概率语言模型 (NPLM)。

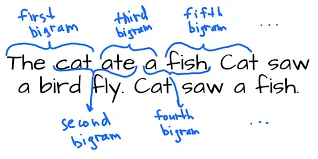

LLM 演进史 (一):Bigram 的简洁之道

从最简单的 Bigram 模型开始,探索语言模型的基础。了解如何通过计数和概率分布来预测下一个字符,以及如何用神经网络框架实现相同的效果。

从 0 实现一个极简的自动微分框架

学习 Andrej Karpathy 的 micrograd 项目,从零开始实现一个自动微分框架,深入理解反向传播和链式法则的核心原理。